Marcelo Finger Alan Barzilay

RNN's

Parte 02: Treinamento Recorrente

Conteúdos

- Recorrência Neural

- Treinamento Recorrente

- Modelos Sequência pra Sequência

- Problemas que Advem da Recorrência

- Soluções para Redes Profundas

Treinamento Recorrente

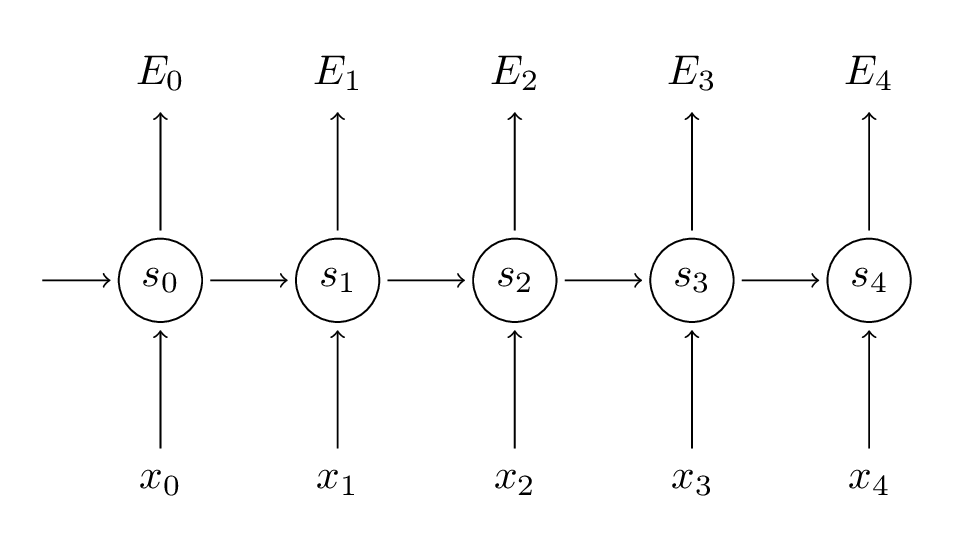

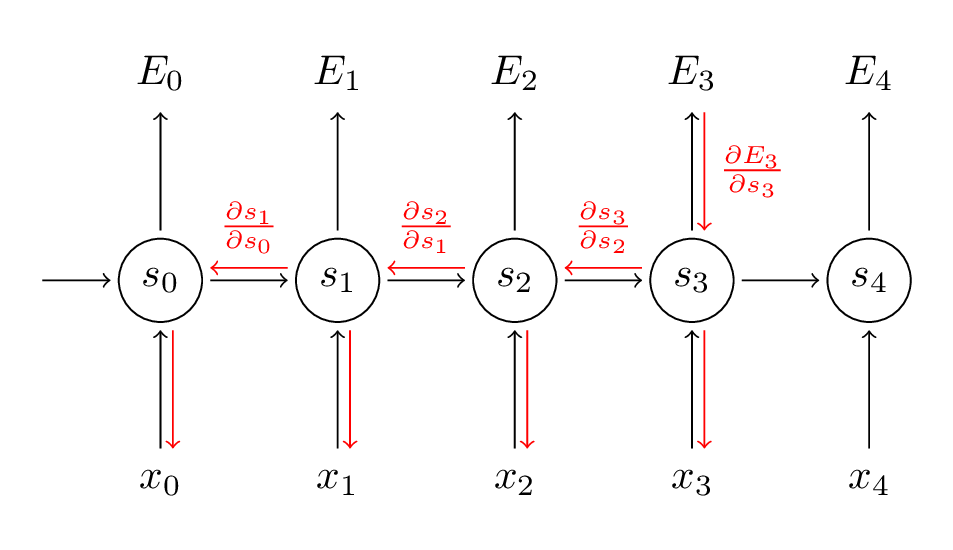

Representação “desenrolada”

Back Propagation Through Time (BPTT)

Back Propagation Through Time (BPTT)

Recorrência: Modelo Formal

h_{t} = f(h_{t-1}, x_t)

p(x_{t,i} = 1| x_{t-1}, . . . , x_1) = \frac{e^{w_i h_t}}{\sum^K_{j=1} e^{w_{j} h_t}}

p(x) = \prod^T_{t=1} p(x_t|x_{t-1}, . . . , x_1)

Estado (oculto) seguinte como função da entrada atual e do estado anterior

Previsão a ser maximizada: probabilidade da próxima palavra

Probabilidade da sentença: